اورفیتینگ در هوش مصنوعی چیست؟

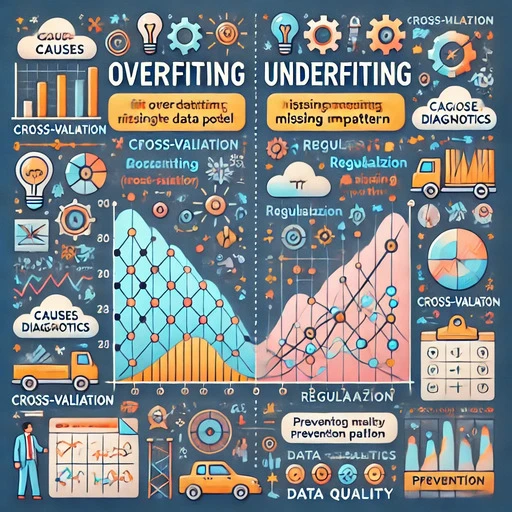

اورفیتینگ در هوش مصنوعی به معنی یادگیری بیش از حد مدل از دادههای آموزش است، بهطوری که مدل به جای تشخیص الگوهای اصلی، جزئیات یا نویز داده را حفظ میکند و در نتیجه عملکرد خوبی روی دادههای جدید ندارد.

در زمینه هوش مصنوعی و مدلهای یادگیری ماشین، اورفیتینگ (Overfitting) یا همان یادگیری بیش از حد، مشکل بسیار رایجیست و زمانی رخ میدهد که مدل، دادههای آموزش را حفظ میکند و بهجای درک الگوهای کلی، به حفظ جزئیات و حتی نویز موجود در دادهها میپردازد. این اتفاق باعث میشود مدل شما فقط روی همان دادههایی که دیده عالی عمل کند، اما روی دادههای واقعی و جدید، عملکرد رضایتبخشی نداشته باشد.

چرا اورفیتینگ یک مشکل است؟

مدل اورفیت شده، عملکردی مشابه یک دانشآموزی دارد که بهجای فهمیدن مفهوم، تمرینها را حفظ کرده است؛ با سوال جدید نمیتواند خوب جواب دهد و در محیط واقعی شکست میخورد.

- دقت بسیار بالا روی دادههای آموزش و دقت پایین روی دادههای تست یا واقعی

- عدم توانایی مدل در تعمیم به شرایط و دادههای جدید

- حساسیت شدید مدل به کوچکترین تغییرات یا نویز در دادهها

| شاخص | مدل اورفیت شده | مدل معمولی |

|---|---|---|

| دقت روی آموزش | ۹۹٪ | ۹۳٪ |

| دقت روی تست | ۶۰٪ | ۹۱٪ |

نکته مهم: اورفیتینگ تعادل بین یادگیری (فیتینگ) و تعمیم پذیری مدل را بر هم میزند. هدف نهایی یک مدل یادگیری ماشین، تعمیم دانش به دادههای جدید است و اورفیت شدن مانع این امر میشود.

برای آشنایی با نقش یادگیری ماشین در هوش مصنوعی و نحوه برخورد با مشکلات اورفیتینگ، ادامه مطلب را در بخشهای بعدی این مقاله بخوانید تا با علتها، راهکارها و نمونههای عملی آشنا شوید.

آندر فیتینگ به چه معناست و چگونه رخ میدهد؟

آندر فیتینگ (Underfitting) یکی از مفاهیم کلیدی در هوش مصنوعی و یادگیری ماشین است که زمانی اتفاق میافتد که مدل یادگیری، آنقدر ساده است یا اطلاعات کافی ندارد که نتواند ساختار و الگوی «واقعی» دادههای آموزشی را یاد بگیرد. در نتیجه، دقت یادگیری پایین و خطای بالا هم در دیتای آموزش و هم در تست دیده میشود.

تعریف ساده آندر فیتینگ

وقتی یک مدل یادگیری ماشین بیش از حد ساده انتخاب شود (مثلاً استفاده از یک خط صاف برای پیشبینی دادههای پیچیده)، سیستم نمیتواند روابط و الگوهای موجود در دادهها را «فرا بگیرد». به اصطلاح، مدل کمهوش یا کمتوان میشود و عملکرد آن پایینتر از حد مطلوب است.

ویژگیهای آندر فیتینگ

- دقت پایین مدل هم در دادههای آموزش و هم تست

- ساده بودن بیش از حد مدل نسبت به پیچیدگی داده

- بالا بودن خطا (Error) حتی بعد از آموزش طولانی

- عدم توانایی مدل در شناسایی الگوهای پنهان

- واکنش ضعیف یا کم به تغییرات تنظیم پارامترها

چگونه آندر فیتینگ رخ میدهد؟

آندر فیتینگ معمولاً بر اثر یکی از وضعیتهای زیر ایجاد میشود:

- مدل خیلی ساده: انتخاب مدلی با قابلیت کم (مثلاً مدل خطی برای دادههای غیرخطی) باعث ناتوانی در یادگیری میشود.

- دادههای ناکافی یا بیکیفیت: اگر تعداد دادههای آموزشی کم باشد یا ویژگیهای کلیدی داده موجود نباشد، مدل نمیتواند عمق مطلب را درک کند.

- آموزش ناکافی: آموزش مدل برای تعداد دورههای کم (Epoch کوتاه) نیز باعث میشود مدل فرصت یادگیری کافی نداشته باشد.

- ویژگیهای ناقص یا نامرتبط: نداشتن ویژگیهای مناسب در ورودی مدل، باعث ناقص ماندن یادگیری میشود.

چرا آندر فیتینگ برای هوش مصنوعی مضر است؟

اگر مدل آندر فیتینگ باشد، چه در آموزش و چه در واقعیت، نتایج ضعیفی تولید شده و نمیتواند به تصمیمات یا پیشبینیهای قابلاعتماد دست یابد.

اما چطور میتوانیم آندر فیتینگ را شناسایی و برطرف کنیم؟ راهکارها و نکات عملی را در بخشهای بعدی این مقاله پیدا میکنید!

| مدل با آندر فیتینگ | مدل مطلوب |

|---|---|

| دقت پایین | دقت قابل قبول |

| خطای آموزش بالا | خطای آموزش پایین |

| عدم تشخیص الگوها | یادگیری مناسب الگوها |

سوالات متداول درباره آندر فیتینگ

- چطور بفهمیم مدل ما دچار آندر فیتینگ شده است؟ دقت پایین در آموزش و تست، علامت اصلی است. جزئیات بیشتر را در بخش شناسایی آندر فیتینگ بخوانید.

- راهکار رفع آندر فیتینگ چیست؟ به زودی در بخش راهکارهای تخصصی پوشش داده خواهد شد!

تفاوت اورفیتینگ و آندر فیتینگ در یادگیری ماشین

یکی از چالشهای مهم در توسعه مدلهای هوش مصنوعی و یادگیری ماشین، حفظ تعادل مناسب بین دقت و تعمیمپذیری است. در این مسیر، دو پدیده متضاد به نامهای اورفیتینگ (Overfitting) و آندر فیتینگ (Underfitting) میتوانند تاثیر منفی جدی بر عملکرد مدلهای یادگیری ماشین داشته باشند. برای درک بهتر، باید به مقایسه اورفیتینگ و آندر فیتینگ بپردازیم و تفاوتهای کلیدی این دو را بررسی کنیم.

مقایسه کلی Overfitting و Underfitting در مدلهای یادگیری ماشین

اورفیتینگ یعنی مدل بیش از حد به دادههای آموزشی وابسته میشود و جزئیات یا حتی نویز دادهها را یاد میگیرد. در نتیجه مدل فقط روی همان دادههای آموزش عالی عمل میکند اما در برابر دادههای جدید (تعمیمپذیری) ضعف جدی دارد.

آندر فیتینگ درست برعکس، زمانی رخ میدهد که مدل هوش مصنوعی به اندازه کافی نتوانسته روابط و الگوهای اصلی دادهها را بشناسد و هم روی دادههای آموزش و هم دادههای جدید عملکرد ضعیفی دارد.

تفاوتهای کلیدی اورفیتینگ و آندر فیتینگ

- در اورفیتینگ: دقت روی دادههای آموزش بیش از حد بالا و روی دادههای تست به شدت پایین میآید.

- در آندر فیتینگ: دقت در هر دو مجموعه (آموزش و تست) پایین است.

- اورفیتینگ نشانه وابستگی بیش از حد مدل به جزئیات و پیچیدگی غیرضروری است.

- آندر فیتینگ نمایانگر سادگی بیش از حد مدل یا ناکافی بودن یادگیری است.

- راهکار مقابله با اورفیتینگ معمولاً کاهش پیچیدگی مدل و استفاده از تکنیکهای regularization است، ولی برای آندر فیتینگ باید ظرفیت (پیچیدگی) مدل را افزایش داد یا ویژگیهای بیشتری استخراج کرد.

جدول مقایسه اورفیتینگ و آندر فیتینگ

اثرگذاری اورفیتینگ و آندر فیتینگ بر عملکرد مدلهای هوش مصنوعی

اگر مدل دچار اورفیتینگ باشد، در ظاهر نتایج بسیار دقیقی روی داده تمرینی نشان میدهد، اما در دنیای واقعی یا با دادههای تازه، کارایی قابل قبولی ندارد. از سوی دیگر، آندر فیتینگ زمانی رخ میدهد که مدل حتی از تشخیص الگوهای اصلی داده ناتوان است و در هیچ شرایطی جواب قابل قبول ارائه نمیدهد.

جمعبندی و نکته مهم برای پروژههای هوش مصنوعی

نکته کلیدی

برای توسعه مدلهای قوی هوش مصنوعی، باید تعادلی هوشمندانه میان دقت و تعمیم پذیری ایجاد کنید تا مدل نه اسیر اورفیتینگ شود و نه با مشکل آندر فیتینگ مواجه گردد.

برای بررسی روشهای رفع و شناسایی هر یک از این پدیدهها، میتوانید به بخشهای بررسی مفاهیم یادگیری ماشین و دیگر سرفصلهای مرتبط همین مقاله مراجعه کنید.

علتهای اصلی بروز اورفیتینگ در مدلهای هوش مصنوعی

اگر شما هم به دنیای هوش مصنوعی و یادگیری ماشین علاقهمندید و میخواهید پروژههای AI موفق داشته باشید، شناخت دلایل اصلی اورفیتینگ یکی از مهمترین قدمهاست. دانستن «چرا و چگونه» یک مدل دچار اورفیتینگ میشود، به شما توانایی بهبود دقت، کاهش خطا و ساخت مدلهایی با تعمیمپذیری بالا را میدهد. در ادامه، رایجترین علتهای بروز اورفیتینگ در مدلهای هوش مصنوعی را به زبان ساده بررسی میکنیم:

/۱. پیچیدگی بیش از حد مدل (Model Complexity)

هر چه مدل شما پارامترهای بیشتری داشته باشد یا عمیقتر (مثلاً شبکههای عصبی بزرگ) باشد، احتمال اورفیتینگ بیشتر است. زیرا مدل به جای یادگیری الگوهای کلی، جزئیات و نویز دادههای آموزشی را هم حفظ میکند.

۲. حجم ناکافی دادههای آموزشی

وقتی دادههای آموزشی کافی ندارید، مدل نمیتواند الگوهای عمومی را یاد بگیرد و ناخواسته به ویژگیهای خاص آن دادههای محدود حساس میشود. این مشکل به ویژه در پروژههای واقعی با منابع داده کم، بسیار رایج است.

- مثال: فقط ۵۰ تصویر برای آموزش یک مدل دستهبندی تصویر

۳. وجود نویز یا ویژگیهای بیربط در دادهها

وقتی دادههای شما شامل اطلاعات غیرضروری یا نویز باشد، مدل به اشتباه این جزئیات را یاد میگیرد و عملکرد آن بر دادههای جدید افت میکند.

- مثال: ستونهایی که هیچ نقشی در پیشبینی ندارند، اما وارد مدل شدهاند

۴. تقسیم نامناسب داده به آموزش و اعتبارسنجی

اگر دادهها بهدرستی به مجموعههای آموزش و اعتبارسنجی (validation) تقسیم نشوند، مدل عملکرد خود را فقط روی دادههایی میسنجد که قبلاً آنها را دیده است، و این باعث اورفیتینگ خواهد شد.

- مثال: تمام دادهها فقط برای آموزش استفاده شود و هیچ دادهای برای تست و اعتبارسنجی باقی نماند.

۵. آموزش بیش از حد مدل (Training Too Long)

اگر مدل را با epoch بالا آموزش دهید، یعنی بارها و بارها دادهها را به مدل نشان دهید، در نهایت به جای یادگیری الگوها، جزئیات و موارد خاص دادهها را حفط میکند.

- مثال: مدل بیش از ۱۰۰ بار روی همان دادهها آموزش ببیند

۶. عدم استفاده از تکنیکهای کاهش اورفیتینگ

استفاده نکردن از روشهایی مثل ریگولاریزیشن (Regularization)، دراپاوت (Dropout) یا کاهش پارامترها، باعث میشود مدل بدون هیچ محدودیتی پیچیده و دقیقاً به دادههای آموزش وابسته شود.

اطلاعات بیشتر درباره راهکارها

اگر به روشهای کاهش اورفیتینگ علاقهمندید، پیشنهاد میکنیم مطلب بررسی مفاهیم یادگیری ماشین و یادگیری عمیق چیست؟ را بخوانید.

۷. نشت داده (Data Leakage)

اگر مدل شما به صورت ناخودآگاه به اطلاعاتی از تست یا آینده دسترسی پیدا کند، نتایج بسیار خوبی در ظاهر میگیرد ولی در واقع عملکرد مدل واقعی نیست و دچار اورفیتینگ شدید خواهد شد.

- مثال: استفاده از اطلاعات «تاریخ تست» در هنگام آموزش

جدول مقایسه علتهای اورفیتینگ و اثرات آنها

| علت | تاثیر روی مدل |

|---|---|

| پیچیدگی بیش از حد مدل | حساس شدن به نویز و جزئیات داده آموزشی |

| حجم داده ناکافی | عدم یادگیری الگوهای عمومی |

| نویز یا ویژگی بیربط | یادگیری اطلاعات غیرضروری |

| تقسیم نامناسب داده | عدم سنجش واقعی عملکرد مدل |

| آموزش بیش از حد | حفظ شدن جزئیات خاص به جای الگوهای اصلی |

| عدم استفاده از روشهای کاهش اورفیتینگ | وابستگی شدید به دادههای آموزش |

| نشت داده | نمایش دقت کاذب، عملکرد غیرواقعی مدل |

نکته کلیدی!

درک درست علتهای اورفیتینگ، شما را در پیادهسازی بهتر مدلهای هوش مصنوعی و تصمیمگیریهای فنی راهبردی یاری میکند. برای آشنایی با راهکارهای عملی کاهش اورفیتینگ، بخش بعدی استفاده از تکنیکهای کاهش اورفیتینگ را از دست ندهید.

روشهای شناسایی آندر فیتینگ در دادههای آموزشی

در آموزش مدلهای هوش مصنوعی و یادگیری ماشین، شناسایی بهموقع آندر فیتینگ (Underfitting) اهمیت کلیدی دارد. اگر این پدیده در مدلهای یادگیری مشاهده نشود، کیفیت پیشبینی و استنتاج مدل به شدت کاهش مییابد. پس آگاهی از بهترین روشهای شناسایی آندر فیتینگ در دادههای آموزشی، مسیر ساخت مدلهای دقیق و موفق هوش مصنوعی را هموار میکند.

مهمترین روشها برای شناسایی آندر فیتینگ در مدلهای هوش مصنوعی

- آنالیز دقت و خطا در دیتاست آموزش و اعتبارسنجی: مدل آندر فیت معمولاً هم روی دادههای آموزش و هم روی دادههای اعتبارسنجی عملکرد ضعیفی دارد و دقت هر دو پایین است.

- بررسی نمودارهای loss/accuracy: مقایسه روند loss و accuracy مدل در حین آموزش. در آندر فیتینگ، منحنیها اغلب کمنوسان و نزدیک به پایینتر مقدارشان هستند.

- استفاده از یادگیری متقاطع (cross-validation): اگر مدل در foldsهای مختلف همیشه خطای زیادی دارد، نشانهای از آندر فیتینگ است.

- آنالیز خطا (Error Analysis): خطای زیاد و مشابه روی هر دو دیتاست train و test بیانگر ناتوانی مدل در یادگیری الگوهای پیچیده است.

- بررسی شاخصهای ارزیابی (Precision, Recall, F1): وقتی این مقادیر برای تمام دستهها پایین (و نزدیک هم) باشد، احتمال آندر فیتینگ بالاست.

- تحلیل باقیماندهها در مدلهای رگرسیون: اگر باقیماندهها ساختار خاصی ندارند و پراکندگی آنها زیاد است، نشاندهنده underfit بودن است.

- بررسی منحنی یادگیری (Learning Curve): مشاهده منحنیهای آموزش و اعتبارسنجی و میزان نزدیکی آنها به پایینترین مقدار.

- استفاده از معیارهای بنچمارک دامنهای: مقایسه امتیاز مدل با حداقل معیارهای صنعتی نشان میدهد که احتمالاً مدل کمتر از حد انتظار یاد گرفته است.

جدول مقایسه شاخصها: آندر فیتینگ در مقابل مدل نرمال

| شاخص | مدل آندر فیتینگ | مدل نرمال |

|---|---|---|

| دقت آموزش | کم و ثابت | بالا و روند افزایشی |

| دقت تست | کم و مشابه آموزش | نسبتاً بالا، کمی پایینتر از آموزش |

| precision/recall/F1 | پایین و نزدیک یکدیگر | بالا و تفکیک بین کلاسها |

| رفتار منحنی یادگیری | تخت و پایین | افزایشی و جدای از هم |

مثال کد شبهپایانی برای شناسایی آندر فیتینگ مدل هوش مصنوعی

if (train_accuracy < threshold && test_accuracy ≈ train_accuracy) {

print("Underfitting detected: Model needs increased complexity/data.")

}

جمعبندی و نکات کلیدی

شناسایی بهموقع آندر فیتینگ نقش مهمی در بهبود کیفیت مدلهای هوش مصنوعی دارد. با پایش دقیق شاخصهای عملکرد، تحلیل منحنیهای یادگیری و بهرهگیری از تکنیکهای مذکور، میتوان از هدررفت منابع و زمان در پروژههای ML جلوگیری کرد. برای یادگیری بیشتر درباره مفاهیم یادگیری ماشین و تفاوت شناسایی خطاها، حتماً مطالب مرتبط را مطالعه کنید.

نقش حجم دادهها در اورفیتینگ و آندر فیتینگ

حجم دادهها یا همان تعداد و تنوع نمونههای آموزشی، از اصلیترین فاکتورهای موثر در عملکرد مدلهای هوش مصنوعی و یادگیری ماشین است. میزان داده آموزش، نه فقط روی دقت نهایی مدل تأثیر مستقیم میگذارد، بلکه یکی از عوامل کلیدی در رخ دادن اورفیتینگ (Overfitting) و آندر فیتینگ (Underfitting) بهشمار میرود.

در صورت استفاده از دادههای اندک و ضعیف، مدل بهراحتی یا دچار حفظ جزئیات غیر ضروری (اورفیتینگ) میشود یا اصلاً قادر به یادگیری الگوی درست (آندر فیتینگ) نخواهد بود. اما کافی بودن حجم و تنوع دادهها، به مدل کمک میکند تا به درستی تعمیم دهد و با دادهی جدید عملکرد دقیق داشته باشد.

تعریف حجم دادهها و اهمیت آن

حجم دادههای آموزشی یعنی تعداد نمونههایی که یک مدل در حین یادگیری مشاهده میکند. هر چه تعداد داده بیشتر و تنوع آن بالاتر باشد، مدل میتواند بهتر الگوهای واقعی را استخراج کند و نسبت به نویز و دادههای ناشناخته مقاومتر شود.

- حجم داده کم (مثلاً ۳۰ عکس برای آموزش حیوانات): مدل ممکن است صرفاً جزییات دادهها را حفظ کند یا حتی الگوها را درک نکند.

🔸 افزایش خطر اورفیتینگ و آندر فیتینگ توأمان - حجم داده متوسط (۳۰۰۰ عکس یا نمونه): عملکرد مدل نسبتاً متعادل خواهد بود، اما هنوز احتمال دارد برخی الگوها را ناقص بیاموزد، بهخصوص اگر دادهها متنوع نباشند.

- حجم داده زیاد (دهها هزار نمونه): مدل با احتمال بالا میتواند تعمیم مناسب داشته باشد و خطر اورفیتینگ و آندر فیتینگ به حداقل میرسد.

| مقدار داده | احتمال اورفیتینگ | احتمال آندر فیتینگ |

|---|---|---|

| کم | زیاد ⬆️ | زیاد ⬆️ |

| متوسط | متوسط | متوسط |

| زیاد | کم ⬇️ | پایین ⬇️ |

نکات مهم درباره حجم دادهها

- کم بودن داده، هم خطر اورفیتینگ مدل را بالا میبرد و هم زمینهساز آندر فیتینگ میشود؛ مثلاً مدل فقط ویژگیهای تکراری را حفظ میکند یا اصلاً چیزی یاد نمیگیرد.

- افزایش تعداد نمونههای آموزشی، به ویژه اگر دادهها متنوع باشند، قابلیت تعمیم و دقت مدل را بیشتر میکند.

- دادههای خیلی زیاد اما یکسان یا بدون کیفیت کافی، باز هم مشکلساز میشود و باید به توازن و کیفیت دادهها هم توجه شود.

- تنوع داده، به اندازه تعداد نمونهها اهمیت حیاتی دارد؛ فقط داده زیاد کافی نیست!

مثال واقعی:

اگر بخواهید مدل شناسایی پرندگان بسازید اما فقط از ۲۰ عکس کاناری استفاده کنید، مدل شما همه عکسها را «کاناری» تصور میکند! این یعنی اورفیتینگ. اما اگر فقط ۲ تا عکس برای هر پرنده داشته باشید و تصاویر کافی از سایر گونهها تهیه نکنید، مدل مرزی بین گونهها پیدا نمیکند و آندر فیتینگ رخ میدهد.

برای آشنایی با راهکارهای عملی جلوگیری از اورفیتینگ و آندر فیتینگ و تکنیکهای متعادلسازی داده، به بخشهای استفاده از تکنیکهای کاهش اورفیتینگ و راهکارهای جلوگیری از آندر فیتینگ مدلهای یادگیری در همین مقاله مراجعه کنید.

نتیجهگیری: قبل از شروع آموزش هر مدل یادگیری ماشین، به حجم، کیفیت، و توازن دادههای خود توجه کنید تا بهترین تعادل بین دقت و تعمیمپذیری را بهدست آورید. این اصل، یکی از پایههای موفقیت در پروژههای هوش مصنوعی است.

استفاده از تکنیکهای کاهش اورفیتینگ

چرا کاهش اورفیتینگ برای موفقیت مدلهای هوش مصنوعی حیاتی است؟

مقابله با اورفیتینگ یکی از مهمترین چالشها در توسعه مدلهای هوش مصنوعی و یادگیری ماشین است. زمانی که یک مدل، فقط به حفظ دادههای آموزش میپردازد و توان تعمیم آن به دادههای جدید پایین میشود، باید از تکنیکهای موثری برای افزایش تعمیمپذیری استفاده کنیم. در ادامه، موثرترین روشهای کاهش اورفیتینگ را برای مدلهای هوش مصنوعی بررسی میکنیم.

-

Regularization (نظیم منظمسازی – L1/L2): افزودن جریمه به تابع خطا برای جلوگیری از بزرگ شدن وزنها. این روش ساختار مدل را سادهتر و تعمیمپذیرتر میکند.

loss = MSE(y_true, y_pred) + λ * Σ|w|

// L1 regularization sample (λ: ضریب تنظیم) - Data Augmentation (افزایش داده مصنوعی): تولید دادههای آموزشی جدید با تغییرات جزئی (مثلاً چرخاندن، برشزدن، نویزافزایی روی تصاویر) که باعث افزایش تنوع دادهها و کاهش حساسیت مدل به نویز میشود.

-

Dropout (برای شبکههای عصبی): بهصورت تصادفی برخی نورونها را حین آموزش غیرفعال میکند تا شبکه نتواند بیش از حد وابسته به قسمتی از ساختارش شود و تعمیم بهتری پیدا کند.

model.add(Dropout(0.3))

# ۳۰٪ نورونها بهشکل تصادفی حذف میشوند - Early Stopping (توقف زودهنگام): آموزش مدل را وقتی عملکرد روی دادههای اعتبارسنجی رو به کاهش میرود متوقف میکند تا مدل فقط روی دیتای آموزش حفظ نشود.

- Cross-Validation (اعتبارسنجی متقاطع): دادهها را به چند قسمت تقسیم میکند و هر بار با بخشی از دادهها مدل را اعتبارسنجی میکند تا از تعمیمپذیری مطمئن شود.

- Model Simplification (سادهسازی مدل): کاهش تعداد پارامترها یا انتخاب مدل با ساختار سادهتر (مثلاً حذف لایههای اضافه در شبکههای عصبی) برای جلوگیری از حفظ جزئیات بیارزش.

- Pruning (هرس مدل): حذف یا غیرفعال کردن نورونها/گرههایی که تاثیر کمی دارند، بهویژه در شبکههای عصبی.

- Ensemble Methods (روشهای ترکیبی مانند bagging و boosting): استفاده همزمان از چند مدل و ترکیب خروجیشان، تا خطاهای مدلهای مجزا جبران شود. مثل Random Forest و XGBoost.

- تولید یا جمعآوری داده آموزشی بیشتر: یکی از سادهترین و موثرترین راهکارها برای کاهش اورفیتینگ، افزایش تنوع و تعداد دادههای آموزش است.

-

Feature Selection (انتخاب ویژگیهای مناسب):

استفاده از ویژگیهای کلیدی و حذف ویژگیهای کماهمیت یا تکراری تا مدل روی دادههای بیاهمیت حساس نشود.

برای آشنایی بیشتر به بخش تأثیر انتخاب ویژگیها بر اورفیتینگ و آندر فیتینگ همین مقاله مراجعه کنید.

مقایسه تکنیکهای اصلی کاهش اورفیتینگ در کاربردهای مختلف

| تکنیک | کاربرد اصلی | مناسب برای |

|---|---|---|

| Regularization | حفظ سادگی وزنها، جلوگیری از بزرگ شدن ضرایب | اغلب مدلهای یادگیری ماشین و عمیق |

| Dropout | کاهش وابستگی نورونها | شبکههای عصبی عمیق |

| Early Stopping | جلوگیری از آموزش بیش از حد | عموم مدلها با داده زیاد |

| Data Augmentation | افزایش دادهها مصنوعی | تصویری، صوتی، متنی |

| Ensemble | ترکیب چند مدل برای تعمیم بالا | دستهبندی و رگرسیون |

انتخاب تکنیک مناسب بر اساس مدل و داده آموزشی

هیچ راهحل یکتایی برای کاهش اورفیتینگ در مدلهای هوش مصنوعی وجود ندارد؛ انتخاب تکنیک بسته به نوع داده آموزشی، معماری مدل و نیاز پروژه متفاوت است. معمولاً ترکیب چند روش نتیجه بهتری در عمل میدهد. برای جزئیات بیشتر و ارتباط این تکنیکها با ویژگیهای ورودی، حتماً بخش تأثیر انتخاب ویژگیها بر اورفیتینگ و آندر فیتینگ را در ادامه مقاله بخوانید!

استفاده از این روشها به شما کمک میکند تا عملکرد مدل یادگیری ماشین خود را در محیطهای واقعی پایدارتر کنید و از مشکلات رایج اورفیتینگ که بسیاری از پروژههای هوش مصنوعی را متوقف میکند، پیشگیری نمایید.

راهکارهای جلوگیری از آندر فیتینگ مدلهای یادگیری

حالا که میدانیم آندر فیتینگ (Underfitting) چگونه میتواند دقت مدلهای هوش مصنوعی را کاهش داده و عملکرد آنها را پایین بیاورد، مهم است که اقدامات پیشگیرانه مناسبی را برای افزایش دقت مدل و حفظ تعمیمپذیری در پروژههای یادگیری ماشین در نظر بگیریم. اگر میپرسید چگونه از آندر فیتینگ در هوش مصنوعی جلوگیری کنیم؟ و بهترین روشهای جلوگیری از underfitting چیست، ادامه این راهنما را بخوانید.

راهنمای اجرایی: بهترین روشهای جلوگیری از آندر فیتینگ

- افزایش پیچیدگی مدل (Model Complexity): اگر مدل یادگیری خیلی ساده است، از مدلهای پیچیدهتر مانند شبکههای عصبی با لایههای بیشتر، یا الگوریتمهایی با انعطافپذیری بالاتر استفاده کنید.

- اضافه کردن ویژگیهای مناسبتر (Feature Engineering): ورودیهای مدل خود را با خلق یا انتخاب ویژگیهای قویتر و معنادار بهبود دهید تا مدل بتواند بهتر روابط داده را یاد بگیرد.

- افزایش حجم و کیفیت دادههای آموزش: جمعآوری دادههای بیشتر و پاکسازی آنها را جدی بگیرید. داده با کیفیت، پایهای برای جلوگیری از underfitting است.

- آموزش طولانیتر مدل (Train Longer): با افزایش epochها و فرصت بیشتر برای یادگیری، مدل شانس بهتری برای کشف الگوها پیدا میکند. اما هرگز آموزش بیش از حد (overfitting) را فراموش نکنید!

- تنظیم هوشمندانه ابرپارامترها (Hyperparameter Tuning): پارامترهای کلیدی همچون نرخ یادگیری، تعداد دستهها، اندازه لایهها و... را به دقت تنظیم کنید تا مدل بهترین عملکرد را نشان دهد.

- کاهش بیمورد Regularization: برخی تنظیمات regularization مثل Dropout یا L1/L2 اگر زیاد باشند، میتوانند باعث ضعیف ماندن مدل شوند. مقدار مناسب را براساس وضعیت پروژه انتخاب نمایید.

- افزودن لایه یا نرونهای بیشتر در شبکههای عصبی: برای مسائلی که دادهها بسیار پیچیدهاند، گسترش معماری شبکه و افزودن نرونها/لایهها یک راه ساده اما کارآمد است.

- استفاده از افزایش داده (Data Augmentation): بخصوص در مسائل تصویری و صوتی، با افزایش دادههای ساختگی اما مشابه واقعی، فرصت یادگیری بیشتر را برای مدل فراهم کنید.

- انتخاب الگوریتم یا معماری مناسب: بسته به نوع داده و هدف پروژه، از الگوریتمهایی استفاده کنید که توان مدلسازی مناسبی داشته باشند و مسئله شما را ساده نکنند.

نکته پایانی

با رعایت این اصول کلیدی، شما میتوانید مدلهای هوش مصنوعی خود را از دام آندر فیتینگ دور نگه دارید و دقت و تعمیمپذیری واقعی را در پروژههای یادگیری ماشین تجربه کنید. پیشنهاد میکنیم برای مطالعه نکات بیشتر درباره ویژگیها و نقش داده در این پدیده، بخشهای آندر فیتینگ به چه معناست و همچنین بررسی مفاهیم یادگیری ماشین را نیز بررسی نمایید.

تأثیر انتخاب ویژگیها بر اورفیتینگ و آندر فیتینگ

یکی از عوامل کلیدی موفقیت مدلهای هوش مصنوعی و یادگیری ماشین در تشخیص الگوهای واقعی داده، انتخاب صحیح ویژگیها (feature selection) است. این انتخاب میتواند مرز بین ایجاد یک مدل باثبات و قابل تعمیم یا مدلی ضعیف و غیرقابلاعتماد باشد. اما چرا؟ چون انتخاب ویژگیهای مناسب، directly روی احتمال بروز اورفیتینگ و آندر فیتینگ تأثیرگذار است.

انتخاب ویژگی بیش از حد و اورفیتینگ

زمانی که تعداد زیادی ویژگی (خصوصاً ویژگیهای بیربط و نویزی) را وارد مدل میکنیم، مدل هوش مصنوعی شروع به یادگیری جزئیات غیرضروری و حتی نویز دادهها میکند. نتیجه این کار، افزایش شدید خطر اورفیتینگ و افت شدید عملکرد مدل بر دادههای جدید است.

- ویژگیهای غیرمرتبط یا تکراری باعث وابستگی مدل به جزییات غیرکلی میشوند.

- حجم بالای ویژگیها مدل را بیش از حد پیچیده و حساس به داده آموزشی میکند.

- معمولاً مدلهای پیچیدهتر، حتی با داده کافی، در صورت وجود نویز زودتر دچار اورفیتینگ میشوند.

حذف بیش از حد ویژگیها و آندر فیتینگ

در مقابل، اگر بیش از اندازه ویژگیها را حذف کنیم یا فقط کمترین و سادهترینها را انتخاب کنیم، مدل نمیتواند الگوهای پنهان و پیچیده را تشخیص دهد. این موضوع اغلب باعث آندر فیتینگ و ضعف قابل توجه در یادگیری میشود.

- ویژگیهای کم یا بیربط، ظرفیت مدل برای شناسایی روابط اصلی را محدود میکنند.

- مدل یادگیری سطحی داشته و حتی روی دادههای آموزش عملکرد خوبی نشان نمیدهد.

- عدم انتخاب ویژگیهای مهم موجب میشود مدل از درک صحیح مسئله باز بماند.

مقایسه تأثیر انتخاب ویژگی غلط بر اورفیتینگ و آندر فیتینگ

روشها و توصیههای کلیدی برای انتخاب ویژگی بهینه

- از روشهای انتخاب ویژگی آماری (مثل فیلترها) برای حذف ویژگیهای کماهمیت یا نویزی استفاده کنید.

- روشهای wrapper و embedded (مثلاً Lasso و درخت تصمیم) را برای انتخاب خودکار مجموعه ویژگیهای بهینه به کار بگیرید.

- ملاک انتخاب را ارتباط با هدف یادگیری و عدم وجود همبستگی بالا بین ویژگیها قرار دهید.

- در صورت شک، با آزمون تدریجی (incremental testing) تعداد ویژگیها را گامبهگام بالا یا پایین ببرید.

- برای پروژههای بزرگ هوش مصنوعی، از ترکیب چند روش و اعتبارسنجی متقابل (cross-validation) بهره ببرید.

نکته راهبردی

انتخاب ویژگیها رابطه مستقیمی با دقت و تعمیم پذیری در مدلهای AI دارد. اگر به دنبال راهکارهای جامعتر برای کنترل اورفیتینگ و آندر فیتینگ هستید، توصیه میکنیم سری به بخشهای بررسی مفاهیم یادگیری ماشین و یادگیری عمیق چیست؟ در وبلاگ بزنید.

جمعبندی و نکات عملیاتی

- همیشه اهمیت ویژگیها را با آزمایش و تحلیل آماری بسنجید، نه با حدس.

- دقت کنید که هر چه مدل به دادههای آموزشی وابستهتر باشد، احتمال اورفیتینگ بالاتر است؛ حذف ویژگیهای غیرضروری بسیار موثر است.

- در عین حال، حذف افراطی ویژگیها نتیجهای جز آندر فیتینگ ندارد.

- هدف نهایی: توازن معقول بین انتخاب ویژگی و سادگی مدل برای رسیدن به عملکرد پایدار و قابل تعمیم⭐

بررسی تاثیر پارامترها و تنظیمات مدل در وقوع این پدیدهها

یکی از مهمترین عوامل موفقیت یا شکست مدلهای هوش مصنوعی در یادگیری ماشین، پارامترها و تنظیمات مدل است. انتخاب هوشمندانه این پارامترها، میتواند مانع بروز دو مشکل جدی اورفیتینگ (Overfitting) و آندر فیتینگ (Underfitting) شود. اما دقیقاً کدام پارامترها نقش کلیدی دارند؟ نحوه تنظیم آنها چه اثری روی عملکرد و تعمیمپذیری مدلهای AI خواهد داشت؟ در ادامه به پاسخ این پرسشها بهصورت تخصصی و به زبان ساده میپردازیم.

کدام پارامترهای مدل بیشترین تأثیر را دارند؟

- تعداد لایهها و نورونها (Model Depth/Width): مدلهای با لایه یا نورون زیاد، معمولا دچار اورفیتینگ میشوند، در حالی که مدلهای خیلی کوچک، اغلب آندر فیت هستند.

- نرخ یادگیری (Learning Rate): نرخ یادگیری خیلی بالا یا خیلی پایین، میتواند موجب نوسان، همگرایی ضعیف یا یادگیری سطحی مدل شود.

- تعداد epoch و batch size: آموزش مدل در تعداد epoch بیش از حد، منجر به اورفیتینگ خواهد شد؛ اما آموزش کم یا batch size بسیار بزرگ، خطر آندر فیتینگ را افزایش میدهد.

- ضریب ریگولاریزیشن (Regularization): مقادیر پایین این ضریب، زمینه اورفیتینگ را فراهم میکند، اما اگر بیشازحد بالا رود، مدل آموزش کافی نمیبیند (آندر فیت).

- فانکشن فعالسازی (Activation Function): بعضی توابع پیچیده یا ساده، بر قدرت مدل در یادگیری الگوهای پیچیده تاثیر مستقیم دارد.

- Dropout/BatchNorm: استفاده یا عدم استفاده از این تکنیکها میتواند مدل را به سمت تعادل یا یکی از دو پدیده سوق دهد.

جدول تاثیر پارامترهای اصلی بر اورفیتینگ و آندر فیتینگ

| پارامتر | تمایل به اورفیتینگ | تمایل به آندر فیتینگ |

|---|---|---|

| تعداد لایه/نورون زیاد | بالا | پایین |

| تعداد لایه/نورون کم | پایین | بالا |

| ریگولاریزیشن کم | بالا | پایین |

| ریگولاریزیشن زیاد | پایین | بالا |

| epoch بالا | بالا | پایین |

| epoch تقریبا کم | پایین | بالا |

انتخاب متعادل این پارامترها مستقیماً جلوی بروز خطاهای رایج هوش مصنوعی را میگیرد.

چگونه تنظیمات مدل موجب اورفیتینگ یا آندر فیتینگ میشود؟

سادهترین مثال: اگر یک شبکه با لایههای بسیار زیاد داشته باشید و داده کافی برای آموزش نباشد یا ریگولاریزیشن را حذف کنید، مدل شما احتمالاً دچار اورفیتینگ میشود و فقط دادههای آموزش را حفظ خواهد کرد. برعکس، اگر ساختار مدل بیش از حد ساده باشد (مثلاً فقط یک لایه یا تعداد نورونهای کم)، حتی الگوهای ساده را نمیآموزد، یعنی با آندر فیتینگ روبرویید.

- افزایش تعداد نورونها ⇨ اورفیتینگ

- کاهش تعداد نورونها ⇨ آندر فیتینگ

- نرخ یادگیری خیلی بالا ⇨ هم مدل را نامتعادل میکند و هم میتواند باعث عدم همگرایی شود.

آیا میدانید حتی یک تغییر کوچک در پارامترهای مدل، میتواند عملکرد یک پروژه هوش مصنوعی را متحول کند؟ همین موضوع نشان میدهد آشنایی با مفاهیم یادگیری ماشین و تنظیم دقیق hyperparameterها چقدر اهمیت دارد.

/purple schemeراهنمای عملی؛ چطور پارامترها را تنظیم کنیم؟

- از روشهایی مثل Grid Search یا Random Search برای یافتن پارامترهای بهینه استفاده کنید.

- نمودار صحت (accuracy)/خطا (loss) مدل را در هر تنظیمات بررسی کنید.

- موازنه بین پیچیدگی مدل و حجم داده را جدی بگیرید.

- مقاومت مدل را با معیارهای ارزیابی صحیح بسنجید، نه فقط دقت در آموزش!

- اگر نشانههای اورفیتینگ/آندر فیتینگ ظاهر شد، پارامترها را به تدریج تعدیل کنید تا به نقطه تعادل برسید.

- همیشه تاثیر تنظیمات مدل را با ابزارهایی مثل بالانس بین دقت و تعمیمپذیری مدنظر داشته باشید.

جمعبندی و نکته کلیدی

تنظیم درست پارامترها، مهارتی اساسی در موفقیت پروژههای هوش مصنوعی است. شما میتوانید با یادگیری اصولی راههای شناسایی آندر فیتینگ و ایجاد تعادل بین دقت و تعمیمپذیری، مدلهای پایدار، دقیق و قابل اعتماد بسازید.

اهمیت بالانس بین دقت و تعمیم پذیری در مدلهای AI

در دنیای هوش مصنوعی، یافتن تعادلی مناسب بین دقت (Accuracy) و تعمیم پذیری (Generalization) شاهکلید ساخت مدلهایی کارآمد، قابل اعتماد و پایدار است. شاید مدل شما روی دادههای آموزش به دقت بالایی برسد، اما آیا میتواند الگوهای واقعی را در دادههای جدید تشخیص دهد و پیشبینی دقیقی ارائه کند؟ اینجاست که اهمیت بالانس بین این دو مفهوم اساسی مشخص میشود.

تعریف دقت و تعمیم پذیری در یادگیری ماشین

| مفهوم | تعریف ساده | اهمیت در هوش مصنوعی |

|---|---|---|

| دقت (Accuracy) | درصد پیشبینیهای درست مدل در دادههای آموزش یا تست | نشاندهنده میزان یادگیری مدل از دادههای موجود |

| تعمیمپذیری (Generalization) | توانایی مدل در عملکرد صحیح روی دادههای جدید و نادیده | نشاندهنده کاربردی بودن مدل در سناریوهای واقعی خارج از دادههای آموزش |

چرا تعادل بین دقت و تعمیمپذیری اهمیت دارد؟

تکیه بیش از حد مدل بر دقت دادههای آموزش میتواند منجر به اورفیتینگ شود؛ یعنی مدل فقط اطلاعات همان دادهها را حفظ میکند و روی دادههای جدید یا متفاوت ضعیف ظاهر میشود. از سوی دیگر، اگر مدل فاقد پیچیدگی کافی باشد و به خوبی الگو نگیرد، آندر فیتینگ رخ میدهد و حتی روی دادههای آموزش هم نتیجه مطلوب حاصل نمیشود.

عواقب بر هم خوردن تعادل دقت و تعمیمپذیری

- • اورفیتینگ: مدل فقط دادههای شناختهشده را میشناسد و در واقعیت کارایی ندارد.

- • آندر فیتینگ: هیچ الگوی معتبری را یاد نمیگیرد—هم در آموزش هم در تست ضعیف است.

- • کاهش اعتماد به مدل: عملکرد غیرقابل پیشبینی یا بیثبات در دنیای واقعی.

- • افزایش هزینه و زمان: نیاز به بازآموزش، جمعآوری داده جدید یا بازطراحی معماری.

ترفندهای دستیابی به توازن ایدهآل بین دقت و تعمیمپذیری

- همیشه علاوه بر دقت، خطا روی دادههای تست و اعتبارسنجی را هم تحلیل کنید.

- به جای تمرکز صرف بر یادگیری از دادههای آموزش، اعتبارسنجی متقابل و آزمون مدل روی دادهی ناشناخته را جدی بگیرید.

- برای بالانس پایدار، معماری مدل و حجم دادهها را متناسب با پیچیدگی مساله انتخاب کنید (نقش شبکههای عصبی و یادگیری ماشین).

- در طول آموزش، منحنیهای عملکرد مدل را پیوسته روی هر دو دسته داده بررسی کنید.

- هرگاه فاصلهٔ آشکاری بین دقت آموزش و تست مشاهده شد، نشانه اختلال در تعادل است.

- پیش از آموزش مدل، در مورد حجم و کیفیت دادهها دقیق باشید (پیشنهاد: نقش حجم دادهها را ببینید).

جمعبندی کلیدی

مدلهای موفق هوش مصنوعی نه صرفا مدلهایی با دقت آموزش بالا، بلکه مدلهایی با تعمیمپذیری واقعی و عملکرد مطمئن روی دادههای جدید هستند. رسیدن به این تعادل یعنی مسیر درست برای حل مسائل واقعی با AI را یافتهاید.

آیا شما هم تجربه مواجهه با مدلهای بیشاز حد دقیق اما ناکارآمد در دادههای واقعی داشتهاید؟ نظرات و تجربیات خود را با ما به اشتراک بگذارید.

برای یادگیری بیشتر، حتماً سری به بخشهای نقش حجم دادهها، تفاوت هوش مصنوعی و یادگیری ماشین و مفاهیم پایه یادگیری ماشین این بلاگ بزنید.

نمونههایی از اورفیتینگ و آندر فیتینگ در پروژههای واقعی

چرا مثالهای واقعی برای درک اورفیتینگ و آندر فیتینگ ضروری است؟

شناخت اورفیتینگ و آندر فیتینگ در محیط تئوری شاید ساده بهنظر برسد، اما در عمل، بسیاری از پروژههای هوش مصنوعی و یادگیری ماشین دقیقا با این مشکلات شکست میخورند یا نتایج غیرقابل اعتمادی ارائه میدهند. مثالهای دنیای واقعی نشان میدهند مدلها چگونه در برابر دادههای جدید ناتواناند یا چرا پیشبینیهایشان فقط روی دیتای آموزش درست است. توجه به این نمونهها باعث بهبود نتیجه و افزایش تعمیمپذیری مدل AI میشود.

مثال واقعی ۱: اورفیتینگ در طبقهبندی تصاویر پزشکی

یک گروه تحقیقاتی در حوزه تصویربرداری پزشکی هدف داشتند با الگوریتم شبکه عصبی عمیق وجود سرطان پوست را در تصاویر تشخیص دهند. آنها دیتاست نسبتا کوچکی شامل چند صد عکس از یک منبع خاص تهیه کردند. مدل روی دادههای آموزش، دقت بالای ۹۸٪ آورد. اما روی تصاویر جدید با دوربین یا شرایط متفاوت، دقت تا ۶۵٪ سقوط کرد! بررسی نشان داد مدل به جای یادگیری ویژگیهای بیماری، نویز، تگ تصویری یا نورپردازی خاص عکسها را حفظ کرده بود.

- نشانههای اورفیتینگ: اختلاف شدید بین دقت روی داده آموزش و تست، ناتوانی عمومیسازی مدل، حدسهای اشتباه روی تصاویر واقعی و جدید

- راه حل پروژه: افزایش حجم و تنوع داده (تصاویر با نور و کیفیت متفاوت)، استفاده از Regularization و Data Augmentation

مثال واقعی ۲: آندر فیتینگ در پیشبینی سریهای زمانی مالی

در پروژه دوم، یک تیم دادهکاوی به دنبال پیشبینی روند قیمت سهام در بازار بورس با رگرسیون خطی ساده بود. با استفاده از دیتاست بزرگ ولی ویژگیهای محدود (فقط قیمت بسته شدن روز قبل)، مدل در هیچ بازهای الگوها را نمیفهمید؛ دقت پایین در آموزش و تست بهطور همزمان مشاهده شد و خطاها دائماً بالا میماند. علت؟ مدل به اندازه کافی پیچیده نبود تا حتی روندهای خطی ساده بازار را یاد بگیرد.

- نشانههای آندر فیتینگ: دقت ضعیف (چه روی آموزش، چه تست)، عدم یادگیری حتی الگوهای پایه

- راه حل پروژه: افزودن ویژگیهای مهم (حجم معاملات، اندیکاتورها)، پیچیدهتر کردن مدل، تست مدلهای غیرخطی

برای مطالعه بیشتر درباره نقش دادهها و انتخاب ویژگی مناسب در کاهش این مشکلات، راهنمای مفاهیم یادگیری ماشین را توصیه میکنیم.

| پروژه | نوع مشکل | نشانهها | راهکار رفع |

|---|---|---|---|

| تشخیص سرطان پوست از عکس | اورفیتینگ | دقت بالا روی آموزش، دقت پایین روی تست/داده جدید | افزایش داده، افزایش تنوع، Data Augmentation، Regularization |

| پیشبینی قیمت بازار بورس | آندر فیتینگ | دقت پایین در همه بخشها، مدل نمیآموزد | افزودن ویژگیها، افزایش پیچیدگی مدل |

نکات کلیدی از تجربه پروژهها (Best Practices)

- همواره عملکرد مدل را روی دیتای جدید و دیدهنشده چک کنید تا اورفیتینگ لو برود.

- مدلی با دقت پایین در هر دو مرحله آموزش و تست، به احتمال زیاد آندر فیتینگ دارد.

- برای چالشهای واقعی، افزایش حجم و تنوع داده و انتخاب مدل صحیح، حیاتی است.

- آزمون مدل با داده واقعی بازار یا دادهای خارج از دیتاست آموزش، نشانههای این پدیدهها را سریع آشکار میکند.

- هوش مصنوعی بدون اعتبارسنجی درست بر روی پروژه دنیای واقعی، فقط تصویر ایدهآل میسازد و نه نتیجه کاربردی.

جمعبندی و اهمیت توجه به مصادیق عملی

مواجه شدن با اورفیتینگ و آندر فیتینگ در پروژههای واقعی، مسیر یادگیری عملی در هوش مصنوعی را هموار میکند. با تحلیل نشانهها و تجربیات دیگران، میتوانید ریسک شکست پروژههای ML/AI خود را به شدت کاهش دهید. اگر شما هم تجربه مشابهی داشتید یا سوالی دارید، در بخش نظرات به اشتراک بگذارید!